Linux数据包发送是一个从用户空间应用程序跨越内核边界,经过复杂的协议栈处理,最终由物理网卡硬件传输到线缆的多阶段过程,这一过程的高效与否直接决定了服务器的网络吞吐能力和响应延迟,理解其核心机制,不仅有助于排查网络故障,更是进行高性能网络优化的基石,Linux内核通过零拷贝技术、协议栈分层处理、队列规则(Qdisc)以及硬件卸载等机制,实现了从软件逻辑到硬件转化的无缝衔接。

用户空间与内核空间的交互

数据包的旅程始于应用程序,当应用调用send或sendmsg等系统调用时,数据并未直接发送,而是从用户态缓冲区复制到了内核态,在这一阶段,内核的核心数据结构Socket Buffer(SKB)被分配,SKB是Linux网络协议栈中管理数据包的基石,它不仅存储了数据本身,还包含了网络协议头、状态信息以及网络设备相关的元数据,为了减少内存拷贝带来的性能损耗,高性能场景通常会采用sendfile系统调用或mmap技术,实现数据在文件系统与网卡之间的直接传输, bypassing(绕过)用户态的昂贵拷贝。

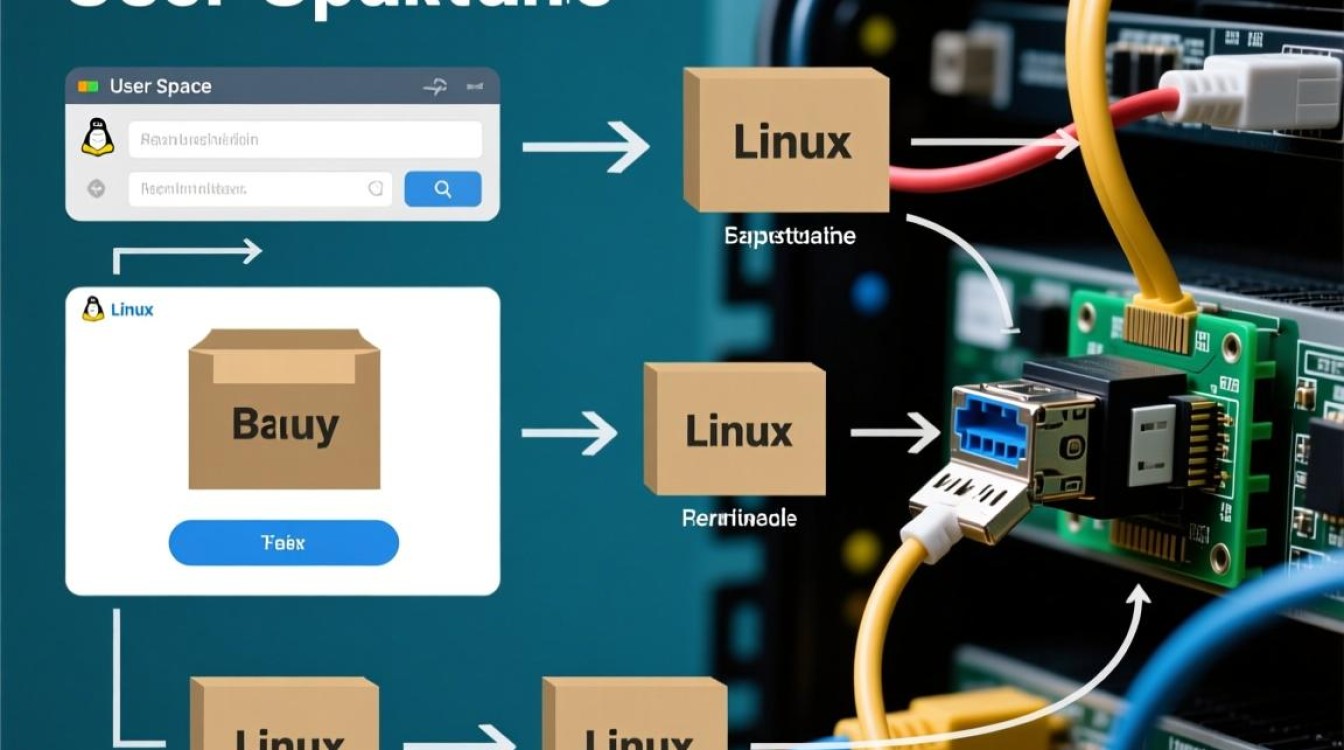

协议栈的分层处理与封装

一旦数据进入内核空间,它将自上而下穿过协议栈,首先传输层(如TCP或UDP)对SKB进行处理,如果是TCP协议,内核会根据拥塞控制算法(如CUBIC或BBR)决定发送窗口和拥塞窗口的大小,并添加TCP头部,随后进入网络层,内核通过路由表查询确定数据包的出口设备,并填充IP头部,在此过程中,邻居子系统负责解析下一跳的MAC地址(通过ARP协议),这一阶段的关键在于路由查找缓存的高效性,以及IP分片与重组的逻辑处理,确保数据包大小符合MTU(最大传输单元)的限制。

流量控制与队列规则(Qdisc)

在数据包到达网卡驱动之前,必须经过流量控制层,这是Linux网络调优中最关键的环节之一,内核通过队列规则对数据包进行排队、调度和整形,默认的Qdisc通常是pfifo_fast,它根据服务类型(TOS)将数据包分为三个优先级队列,在高带宽低延迟的场景下,BQL(Byte Queue Limits)和FQ(Fair Queuing)等队列机制更为有效,它们能够限制网卡驱动队列中的字节数,防止Bufferbloat(缓冲区膨胀)导致的TCP延迟增加,如果Qdisc队列满了,数据包将被丢弃,此时TCP协议栈会感知到丢包并触发拥塞控制机制,从而降低发送速率。

驱动层与硬件交互

当数据包通过Qdisc后,便进入网卡驱动层,驱动程序将SKB映射到网卡可访问的内存区域,通常通过DMA(直接内存访问)技术,将数据包的物理地址写入网卡的Ring Buffer(环形缓冲区),Ring Buffer是驱动与硬件通信的桥梁,它描述了待发送数据包的位置,CPU不再需要逐字节拷贝数据,而是由网卡控制器直接读取内存数据,为了进一步提升性能,现代网卡支持硬件卸载特性,如TSO(TCP Segmentation Offload)和LRO(Large Receive Offload),TSO允许网卡将大的TCP数据包分割成符合MTU大小的帧,从而减轻CPU的负担。

网络硬件发送与物理传输

网卡硬件从Ring Buffer中读取描述符,获取数据地址,并通过PHY层将数字信号转换为模拟信号(光信号或电信号),发送到物理介质上,在这个过程中,中断合并技术起着重要作用,网卡可以产生中断通知CPU数据包发送完成,但在高吞吐量下,频繁的中断会打断CPU的处理,通过中断合并,网卡会将多个发送完成事件合并为一个中断,显著降低CPU占用率,但也可能引入微小的延迟。

专业优化与故障排查建议

在实际生产环境中,如果发现发送包丢包或吞吐量上不去,应遵循由上至下的排查思路,首先检查应用层的Socket缓冲区大小(net.core.wmem_max),过小的缓冲区会导致数据在用户态阻塞,监控Qdisc队列的丢包情况(使用tc -s qdisc查看),如果队列持续满载,考虑升级带宽或优化拥塞算法,关注Ring Buffer的溢出(ethtool -S查看tx_missed_errors),这通常意味着CPU处理速度跟不上网卡发送速度,需要增加队列长度或开启多队列网卡结合RPS(Receive Packet Steering)和XPS(Transmit Packet Steering)进行软中断负载均衡。

相关问答

Q1:Linux网络发送中,什么是TSO(TCP Segmentation Offload),它对性能有何影响?

TSO是一种网络硬件卸载技术,在传统的网络发送过程中,CPU需要将大的TCP数据段分割成符合MTU大小的IP数据包,这消耗大量的CPU资源,开启TSO后,TCP/IP协议栈可以将最大达到64KB的数据包直接传递给网卡驱动,网卡硬件负责将这些大数据包分割成小的帧,这极大地减少了CPU的消耗,提高了大数据传输的吞吐量,但在某些需要精细控制网络延迟或进行包抓包分析的场景下,可能需要关闭TSO以还原真实的网络流量。

Q2:如何判断网络丢包是发生在Qdisc队列还是网卡驱动层?

可以通过精准的命令行工具进行区分,首先使用tc -s qdisc show dev eth0查看特定网卡的Qdisc统计信息,重点关注drops字段,如果有数值增加,说明丢包发生在内核的流量控制层,通常是因为发送速率超过了接口带宽或队列限制,如果Qdisc无丢包,但使用ethtool -S eth0查看网卡统计时发现tx_missed_errors或tx_fifo_errors增加,则说明丢包发生在驱动与硬件交互的Ring Buffer层面,通常是因为CPU处理软中断太慢,导致网卡发送队列溢出。

如果您在服务器网络调优过程中遇到过关于UDP高并发发送的疑难杂症,或者对多队列网卡的中断亲和性设置有独特的见解,欢迎在评论区分享您的经验与问题,我们一起深入探讨。