虚拟机网络性能的优化并非单一维度的调整,而是一个涉及网络模式选择、虚拟化驱动类型、宿主机资源调度以及系统内核参数调优的系统工程。核心上文归纳在于:要实现虚拟机网速的飞跃,必须摒弃默认的模拟硬件配置,转而采用半虚拟化驱动(如Virtio或VMXNET3),配合桥接网络模式,并对宿主机与虚拟机的TCP/IP堆栈进行针对性优化。 只有打通这三个层面的瓶颈,才能消除虚拟化层带来的损耗,使虚拟机网络吞吐量逼近物理网卡的理论极限。

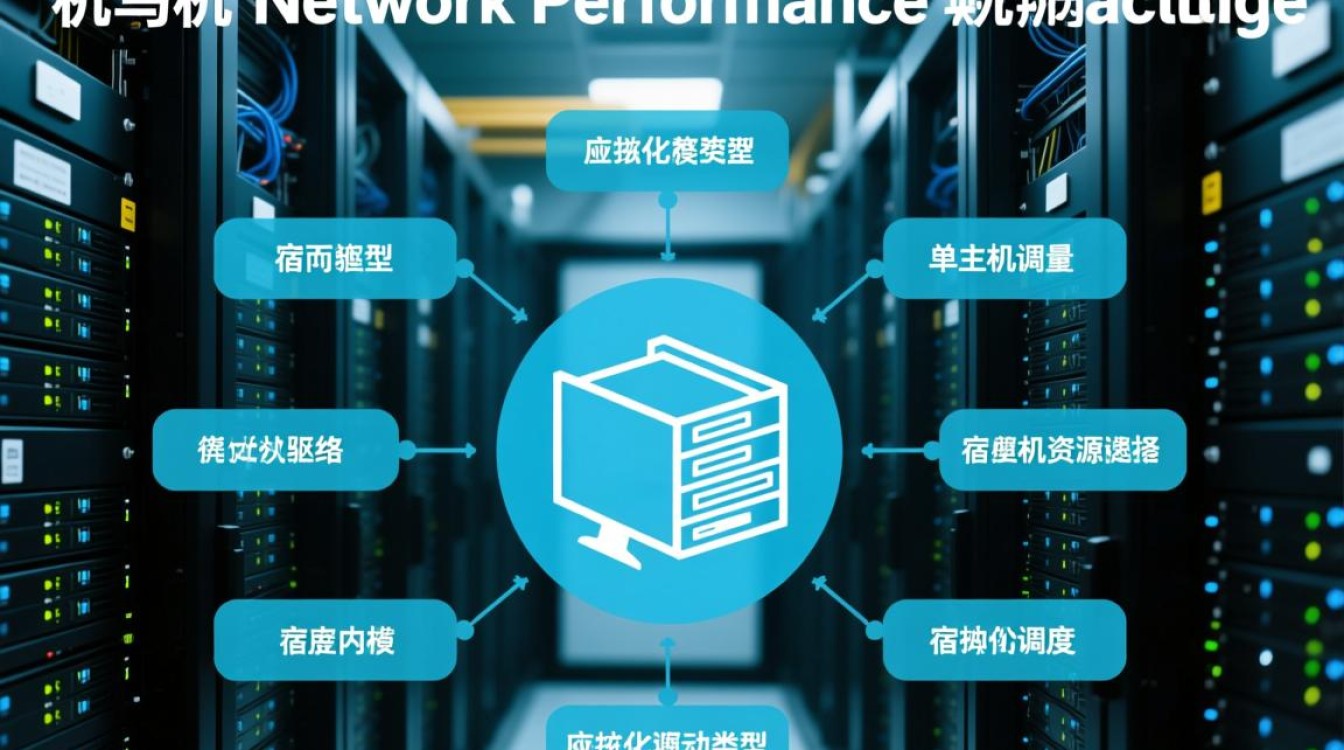

网络适配器模式的选择与底层逻辑

虚拟机的网络模式直接决定了数据包的传输路径和处理开销,这是影响网速的第一道关卡,在常见的NAT模式、桥接模式和仅主机模式中,桥接模式是追求极致网络性能的首选。

NAT模式虽然配置简单,适合宿主机与虚拟机之间的单向访问,但其数据包必须经过宿主机的NAT引擎进行地址转换和路由转发,这一过程不仅增加了CPU的计算负担,还引入了额外的延迟,导致在高并发传输时吞吐量大幅下降,相比之下,桥接模式将虚拟机的网卡直接桥接到宿主机的物理网络接口上,使虚拟机在局域网中拥有一个独立的IP地址,就像一台独立的物理设备,数据包可以直接进出物理网卡,绕过了宿主机操作系统的协议栈转换,从而显著降低了延迟并提升了带宽利用率。

对于需要更高性能的场景,如服务器虚拟化,还可以考虑SR-IOV(单根I/O虚拟化)技术,这允许虚拟机直接访问物理网卡的PCIe资源,几乎完全绕过Hypervisor层,实现接近原生的网络性能,但这需要物理网卡硬件的支持。

虚拟网卡驱动的核心差异:模拟 vs 半虚拟化

很多用户在使用虚拟机时,往往忽略了网卡驱动类型的选择,默认使用模拟的Realtek或Intel E1000网卡,这是导致网速慢的根本原因之一。模拟网卡通过软件完全模拟物理硬件的行为,每一次数据包的收发都需要触发CPU中断和上下文切换,效率极低。

为了解决这个问题,必须采用半虚拟化驱动,在KVM/QEMU环境下,应选择Virtio驱动;在VMware环境下,则应选择VMXNET3驱动。

半虚拟化的工作原理在于,Guest OS(虚拟机操作系统)和Host OS(宿主机操作系统)都知道自己运行在虚拟化环境中,它们通过共享内存(Ring Buffer)和“前后端”驱动架构直接通信,而不是模拟硬件中断,当虚拟机有数据发送时,前端驱动直接将数据放入共享内存,并通过通知机制告知后端驱动,后端驱动直接由宿主机处理并送入物理网卡,这种机制大幅减少了上下文切换和CPU拷贝开销,在大文件传输和高带宽场景下,性能提升通常可以达到2倍甚至5倍以上,安装虚拟机时,务必确认是否加载了Virtio或VMXNET3驱动,这是提升网速最立竿见影的专业手段。

宿主机资源调度与CPU亲和性

网络I/O操作本质上是CPU密集型任务,如果虚拟机的vCPU(虚拟)被频繁在不同的宿主机物理核心(pCPU)之间迁移,会导致CPU缓存的失效,进而严重影响网络包的处理效率。为了稳定网速,必须配置CPU亲和性,即绑定虚拟机的vCPU到特定的宿主机物理核心上。

宿主机的电源管理策略也至关重要,为了节能,操作系统往往会在CPU负载低时降低频率或进入C-state睡眠状态,当网络突发流量到来时,CPU从睡眠状态唤醒需要微秒级的时间,这会导致网络包的丢包和延迟抖动,专业的解决方案是将宿主机BIOS和操作系统电源管理设置为“高性能模式”,并在宿主机内核参数中禁用深度C-state(如intel_idle.max_cstate=1),确保CPU始终处于即时响应状态。

对于多队列网卡,还应确保RSS(接收端扩展)功能开启,RSS能够将网络流量哈希分发到多个处理队列中,利用多核CPU并行处理网络中断,避免单核过载导致的软中断丢包。

系统级TCP/IP参数深度调优

即使硬件和驱动层面配置完美,如果操作系统的TCP/IP参数未针对虚拟化环境优化,依然无法发挥最大性能,默认的Linux或Windows网络配置通常是针对广域网或低带宽环境设计的,较为保守。

在Linux虚拟机中,可以通过修改/etc/sysctl.conf进行调优。增大TCP接收和发送缓冲区大小,默认值往往较小,在高带宽高延迟(BDP)网络中无法填满管道,建议将net.core.rmem_max和net.core.wmem_max设置为较大的值(如16777216),并将net.ipv4.tcp_rmem和net.ipv4.tcp_wmem的最小值、默认值、最大值相应调大。

开启TCP窗口缩放选项(net.ipv4.tcp_window_scaling = 1),以支持大于64KB的TCP窗口,这对于千兆及以上网卡是必须的。

对于Windows虚拟机,可以通过注册表调整TcpWindowSize、GlobalMaxTcpWindowSize等参数。禁用虚拟机内的“任务卸载”功能(如Large Send Offload, LSO)在某些老旧的虚拟化平台上反而能提高稳定性,但在现代半虚拟化驱动(如Virtio)下,通常建议开启TSO(TCP Segmentation Offload)和GSO(Generic Segmentation Offload),让宿主机或物理网卡负责分片,以降低虚拟机CPU的消耗。

相关问答

Q1:为什么我的虚拟机使用了桥接模式,网速依然很慢?

A1: 桥接模式虽然绕过了NAT转换,但如果网速依然慢,通常是因为网卡驱动类型错误,请检查虚拟机配置,确保使用的是半虚拟化驱动(如Virtio或VMXNET3),而不是模拟的E1000或RTL8139,模拟驱动会因频繁的中断模拟严重拖累性能,请确认宿主机的物理网卡的“任务卸载”功能没有与虚拟机驱动产生冲突,必要时尝试在宿主机网卡设置中关闭“大型发送卸载IPv4”选项进行测试。

Q2:在虚拟机中进行大文件传输时,如何判断是CPU瓶颈还是磁盘I/O瓶颈?

A2: 可以使用性能监控工具进行区分,在Linux下使用top或htop命令查看CPU的si(软中断)和st(CPU窃取时间)指标,如果si或st过高,说明网络处理占用了大量CPU或宿主机资源争抢严重,属于网络/CPU瓶颈,如果CPU使用率不高,但传输速度上不去,则应使用iostat命令检查虚拟机的磁盘I/O等待时间(%iowait),若该值很高,则说明磁盘读写速度限制了网络吞吐量,此时应考虑使用virtio磁盘驱动或增加虚拟磁盘队列数。

希望以上关于虚拟机网络优化的深度解析能帮助您解决网速瓶颈,如果您在调整Virtio驱动或内核参数过程中遇到具体问题,欢迎在评论区分享您的系统环境,我们将为您提供更具体的排查建议。